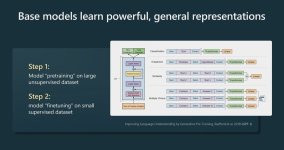

Карпатый сделал вчера презу в Microsoft и хорошо раскидал.

От токенизации, до претрейна, supervised файнтюнинга и RLHF. И все это за 40 минут.

Как выжать максимум из GPT: Пара советов от Карпатого, с моими добавками

Цель 1: Достигнуть максимально возможной производительности с GPT:

— Используйте GPT-4. Пишите промпты с подробным контекстом задачи, актуальной информацией и инструкциями

— Автоматически ищите и добавляйте любой релевантный контекст или информацию в промпт, например используя текстовые эмбеддинги.

— Экспериментируйте с методиками промпт-инжиниринга

— Экспериментируйте в промпте с few-shot примерами, которые 1) актуальны для вашей задачи, 2) разнообразны (если возможно)

— Экспериментируйте с инструментами/плагинами, чтобы помочь LLM решать сложные для нее задачи (калькулятор, выполнение кода, ..)

— Потратьте время, оптимизируя свой пайплайн ("цепь" операций), например в langchain (https://python.langchain.com/en/latest/index.html)

— Если вы уверены, что выжали максимум из промптов, то рассмотрите возможность сбора качественных данных для supervised fine-tuning + сам fine-tuning

— Уровен сложности "Эксперт" / "ресерчер": соберите данные для модели Reward и зафайнтюньте с помощью RLHF.

Цель 2: Оптимизация затрат

— Как только вы достигли максимально возможной производительности, попробуйте сэкономить бабло (например, используйте GPT-3.5, найдите более короткие промпты и т.д.)

От токенизации, до претрейна, supervised файнтюнинга и RLHF. И все это за 40 минут.

Как выжать максимум из GPT: Пара советов от Карпатого, с моими добавками

Цель 1: Достигнуть максимально возможной производительности с GPT:

— Используйте GPT-4. Пишите промпты с подробным контекстом задачи, актуальной информацией и инструкциями

— Автоматически ищите и добавляйте любой релевантный контекст или информацию в промпт, например используя текстовые эмбеддинги.

— Экспериментируйте с методиками промпт-инжиниринга

— Экспериментируйте в промпте с few-shot примерами, которые 1) актуальны для вашей задачи, 2) разнообразны (если возможно)

— Экспериментируйте с инструментами/плагинами, чтобы помочь LLM решать сложные для нее задачи (калькулятор, выполнение кода, ..)

— Потратьте время, оптимизируя свой пайплайн ("цепь" операций), например в langchain (https://python.langchain.com/en/latest/index.html)

— Если вы уверены, что выжали максимум из промптов, то рассмотрите возможность сбора качественных данных для supervised fine-tuning + сам fine-tuning

— Уровен сложности "Эксперт" / "ресерчер": соберите данные для модели Reward и зафайнтюньте с помощью RLHF.

Цель 2: Оптимизация затрат

— Как только вы достигли максимально возможной производительности, попробуйте сэкономить бабло (например, используйте GPT-3.5, найдите более короткие промпты и т.д.)